AI 生成代码隐忧, 人工审查缺口成安全新威胁

- 2025-06-30 04:37:03

- 336

IT之家6月20日消息,Cloudsmith于6月18日发布报告,指出AI生成的代码数量激增,但人工代码审核无法同步跟上。

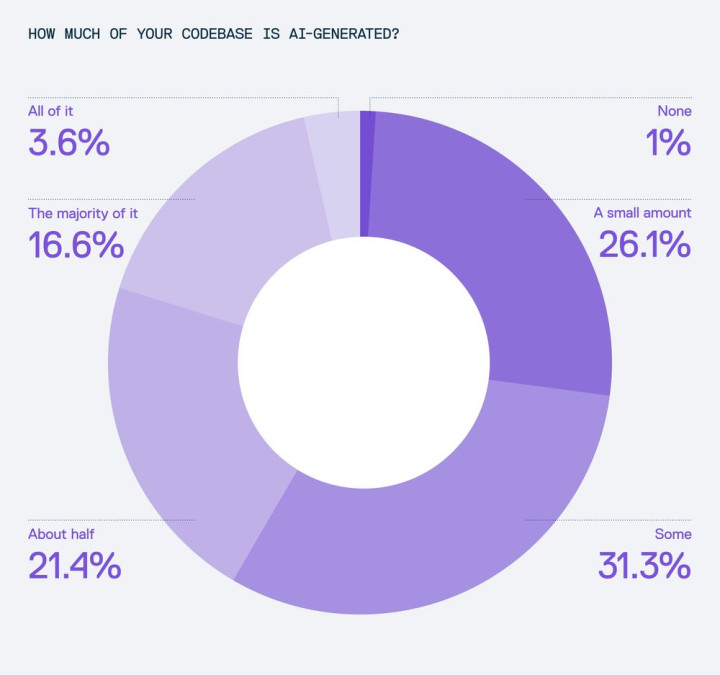

IT之家援引报告内容,在使用AI的开发者中,42%的代码由AI生成,其中16.6%的开发者依赖AI贡献“大部分”代码,3.6%的代码完全由机器生成。

这一趋势在GitHub2024年的调查中得到印证:美国、巴西、德国、印度四国中,超97%的开发者曾使用AI编码工具,且88%-59%的受访者表示公司“至少部分支持”此类工具。

报告也指出AI快速生成代码的背后存在隐忧。调查显示开发者普遍担忧,AI可能加剧开源恶意软件威胁:79.2%的受访者认为AI将增加环境中恶意软件数量,其中30%认为威胁将“显著上升”。

Cloudsmith警告,三分之一的开发者未在每次部署前审查AI生成的代码,导致“大量代码未经验证”直接投入生产环境,形成供应链漏洞。

更关键的是,由于AI“快速复用未知或不可信代码”,代码完整性、依赖管理、SBOMs(软件物料清单)等传统风险被放大。开发者坦言,AI输入在“代码生成阶段”风险最高,仅40%认为该环节需严格管控。

Cloudsmith建议,需通过“智能访问控制”和“端到端可见性”强化制品管理,并采用动态访问策略与“政策即代码”框架。针对AI生成的代码,需强制执行自动政策,标记未经审查或不可信的AI制品,并通过“溯源追踪”区分人机代码。

- 上一篇:长安的荔枝原著

- 下一篇:都火了方圆脸时代怎么还没来