AI陪伴之于青少年用户, 比游戏更像洪水猛兽

- 2025-07-17 15:32:20

- 858

如今在一众AI应用中,AI陪伴几乎毫无疑问是最有话题性的存在,其精准击中了现代人渴望发展一段社交关系,却又吝于投入情感的现实。在其他AI应用还在苦苦探索商业模式时,AI陪伴应用已经成为了一个“小而美”的赛道,让许多相关团队都赚到了大钱。

但一个有意思的现实是,对于能赚钱的AI陪伴、AI伴侣,科技巨头却是敬而远之。比如谷歌高管Rick Osterloh在接受采访时就曾表示,AI融入生活是新的趋势,但像电影《Her》一样让人类与AI谈恋爱则是一种悲剧。OpenAI的CEO山姆·奥尔特曼更是在公开演讲中也提及,“AI伴侣”只是个美丽的陷阱,千万不要轻易尝试。

事实上,这些大厂已经洞察到了AI陪伴应用的危险性,因为它会让某些用户不自觉地沉溺于一段虚幻的感情,乃至为这段关系付出实实在在的代价。

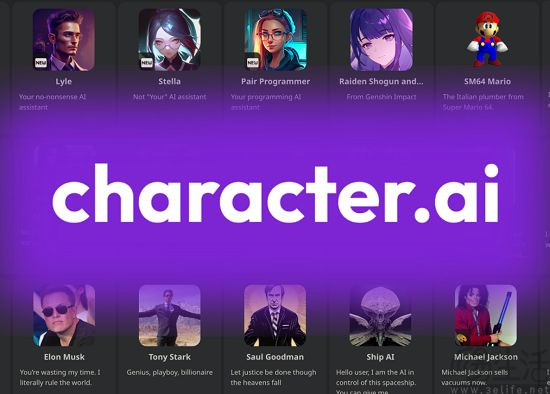

日前,互联网安全组织Internet Matters的相关报告显示,在过去的18个月里,英国9至17岁的少年儿童使用AI聊天机器人的比例大幅上升。而青少年在现实社交关系缺失的情况下,通过ChatGPT、Character.AI等平台寻求陪伴的趋势,也引发了许多专家的担忧。

Internet Matters调查了1000名年龄在9至17岁之间的儿童和青少年,其中有67%的受访者经常使用AI聊天机器人,并且他们在以更加情绪化的方式使用AI,比如寻求陪伴或建议。此外,有35%的孩子表示与AI对话“就像在和朋友聊天”,12%的孩子则认为他们这样做是因为“没有其他人可以交谈”。

专家的担忧并非毫无道理,因为提供陪伴服务的AI聊天机器人此前曾有过诱导青少年的前科。去年10月有美国媒体报道称,佛罗里达州一位14岁的少年在与Character.AI的聊天机器人进行长时间对话后自杀身亡,随后Character.AI火速发布致歉声明,宣布针对未成年人的模型进行更改,降低他们接触敏感或暗示性内容的可能。

无独有偶,国内也有媒体在今年6月集中报道了AI聊天App筑梦岛对青少年进行语言暴力,乃至诱导青少年进行擦边类内容互动。

其实AI陪伴应用出现这一现象的原因很简单,因为此类产品要赚钱就需要首先让用户产生粘性,而用户粘性的基础则是AI能为他们提供情绪价值。

为此,AI陪伴应用会主动选择与用户做朋友,给予用户支持,耐心倾听、并提供中肯的建议。对于绝大多数三观已经基本建立的成年人而言,这一设定在强化AI陪伴应用情绪价值的同时,并不妨碍他们认识到AI只是虚拟的。可成年人能及时从与AI产生的关系中抽离,青少年用户就未必了。

从媒体的相关报道中不难发现,受到AI陪伴应用伤害的青少年,无一例外都沉溺于AI编织的梦中不愿清醒。有用户是这样评价筑梦岛的,“AI不会讨厌我,不会跟我吵架,能给我情绪价值,在我迷茫时为我指引,这就够了。”

如今的现实是随着信息社会的构建走向成熟,个体的原子化已经成为了全球不同区域、不同类型现代文明的共同现象,所以进行“独处中的交流”就成为了许多网民聊以自慰的方式。君不见即便是以多子女家庭为主的欧美,每八人中就有一人使用AI陪伴应用是因为“没人可说”。

毕竟不是任何人都有能力和勇气去发展一段社交关系,这时候AI的出现就解决了这个问题。为了赚钱,AI陪伴应用的开发者往往会将其设计得极有包容性,它们会扮演一个值得信赖、毫无偏见的倾听者,而这种高度情感化的交互就可能会让孩子混淆人与工具的界限。

此外值得一提的是,AI陪伴应用在青少年群体中泛滥,除了青少年本身有寻求情感陪伴的需求,家长们的推波助澜同样不可忽视。AI陪伴应用的重点是“陪伴”,所以它能将家长从对孩子的陪伴中解脱出来,让父母“偷懒”。让孩子与AI作伴、解决缺乏玩伴的问题,其实就是相当多的家长对于孩子使用AI陪伴应用视若无睹的关键。

相比于被视为洪水猛兽的游戏,AI陪伴应用的陪伴作用让不少家长无视了其中的风险,以至于当孩子沉迷其中后,他们并没有及时干预。用Internet Matters方面的说法,AI陪伴应用的渗透速度远超公众认知,它的潜在风险更不为大众所知,所以学校、家长和监管机构需要做好应对的准备。